IBMは9月8日、企業向けAIとデータのプラットフォームである「IBM watsonx」(以下、watsonx)の機能強化内容を発表したが、それに続けて同月12日、IBM独自の基盤モデルとして「Granite」をリリースした。

Granite(グラナイト、花崗岩)シリーズ・モデルと呼ばれるこの基盤モデル群は、AI構築のための企業向けスタジオである「watsonx.ai」に追加され、言語とコードの両方に生成AI機能を提供する。ちなみにIBMでは独自の基盤モデルシリーズにGranite(花崗岩)、Sandstone(砂岩)、Obsidian(黒曜石)、Slate(粘板岩)など地質学をテーマにしたコードネームを付けている。

ビジネスをターゲットにしたIBMの基盤モデル「Granite」

IBMリサーチによって開発されたGraniteモデル(Granite.13b.instructおよびGranite.13b.chat)は、文中で次の単語を予測する現在の大規模言語モデル(LLM)の能力を支える「デコーダー」アーキテクチャを使用している。

130億パラメータのGraniteモデルは、より大きなモデルよりも効率的であり、V100-32GBのシングルGPUにフィットしている。また要約、質問応答、分類などの特殊なビジネス領域のタスクで優れた性能を発揮しつつ、環境負荷を抑えられることに特徴がある。

さらに業界を超えて広く適用が可能であり、コンテンツ生成、洞察抽出、RAG(Retrieval-Augmented Generation:モデルを外部の知識源にリンクさせることで応答品質を向上させるフレームワーク)、固有表現抽出(テキスト内の重要な情報を識別して抽出)といった他の自然言語処理(NLP)タスクもサポートしている。

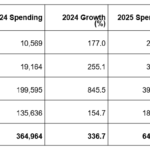

企業向けAIとデータのプラットフォームを掲げるwatsonxでは、ビジネスを対象としたモデルの構築に注力している。Graniteモデル・ファミリーも同様で、前処理前は合計7TB、前処理後は2.4TBに及ぶさまざまなデータ・セット(これはモデルにとって1兆個のトークンに相当)によって学習している。データ・セットの選択は、ビジネスユーザーのニーズをターゲットとしており、以下の領域のデータが含まれる。

インターネット:公共のインターネットから取得した一般的な非構造化言語データ

学術:科学技術に特化した技術的な非構造化言語データ

コード:さまざまなプログラミング言語をカバーする非構造化コードのデータ・セット

法務: 法律意見書やその他の公的提出書類から取得した企業関連の非構造化言語データ

財務:一般に公開された財務文書や報告書から取得した企業関連の非構造化データ

企業に特化したデータ・セットでモデルをトレーニングすることで、IBMのモデルがこれらの業界の専門的な言語や専門用語に精通し、関連する業界知識に基づいた意思決定を行うことを確実にすると指摘している。

中傷・憎悪・冒涜的なコンテンツを除去して品質強化

生成AIが憎悪や中傷的な出力を生成するリスクが懸念されている。IBMではGraniteモデルから憎悪的で冒とく的なコンテンツを検出・除去するために、IBM独自の言語モデルである「HAPディテクター」によって精査されたデータにより学習させている。文書の各文章にスコアを割り当てた後、文章とスコアに対して分析が実行されて分布が求められ、フィルタリングの対象となる文章の割合が決定される。

これ以外にも、幅広い品質評価を適用している。出力の質を向上させるために重複を検索・削除し、文書品質フィルターを使用して、学習に適さない質の低い文書をさらに削除する。また海賊版コンテンツやその他の不快な資料を掲載していることで知られるWebサイトを監視して慎重に避けるなど、定期的かつ継続的なデータ保護対策も実施している。

Graniteモデルは、IBM独自の基盤モデルとして最初の発表となるが、他言語モデルも計画されており、IBMで学習されたそれ以外のモデルも準備中である。

その一方で、オープンソース・モデルの追加も続いている。Meta社のLlama 2-chat(700億パラメータ・モデル)は一部のユーザーを対象に早期アクセスを提供開始しており、9月後半にはより広範に利用可能となる予定である。

さらに80以上のプログラミング言語、Git commit、GitHub issues、Jupyter notebookを含む、コード向けの大規模言語モデルであるHugging Face社の「StarCoder」も追加している。

[i Magazine・IS magazine]